1月26日,腾讯董事会主席兼首席执行官马化腾在内部员工大会上,罕见谈及字节跳动与中兴联合推出的豆包手机,并点评阿里“千问”AI Agent与阿里系业务的联动。马化腾表示,腾讯一直旗帜鲜明反对以黑产外挂等方式把用户手机、电脑屏幕录制并上传云端,认为这类做法“不安全”“不负责任”。这番言论犹如一颗石子投入AI产业的湖面,迅速引发业界对AI助手及智能体安全性的热烈讨论。

面对质疑,豆包手机助手第一时间作出回应,强调其严格遵循用户授权与合规原则,仅在用户明确授权前提下调用必要能力;在云端处理屏幕内容时坚守“不存储、不训练”底线,数据传输全程加密,通过多重保护措施确保用户隐私安全。

奇安信昆吾实验室AI安全专家认为,这场巨头间的安全之争,不仅暴露了AI智能体发展中的核心矛盾,更揭示了一个关键趋势:随着AI助手从对话工具升级为跨场景“超级代理”,安全已成为制约行业发展的核心议题,智能体安全需求正在迎来爆发前夜。

巨头逐鹿AI助手,智能体崛起引发安全焦虑

2026年的AI产业,正从底层模型的参数竞赛全面转向应用层的智能体角逐。科技巨头们纷纷加码AI助手赛道,推动智能体技术加速落地,却也让安全隐患逐渐浮出水面。

1月15日,阿里千问APP正式上线AI Agent“任务助理”1.0版,率先开启AI购物测试。该版本全面打通阿里生态,用户通过自然语言指令,即可让智能体完成淘宝商品搜索、支付宝支付、飞猪机票预订、高德地图导航等跨应用操作,实现“一句话搞定复杂任务”的体验革新。

而字节跳动与中兴联合推出的豆包AI手机,更是将智能体能力推向新高度——AI助手可直接模拟用户操作,完成APP启动、消息发送、游戏代打等系统级任务,凭借“全场景代劳”功能引发市场震动。

国际巨头同样动作频频。Meta以数十亿美元完成对通用Agent产品Manus母公司蝴蝶效应的收购,创下其史上第三大收购案,彰显了对智能体赛道的战略重视。

而微软将多智能体系统(MAS)定为2026年AI战略“胜负手”,依托Azure云服务与Office生态,构建跨场景协同能力,OpenAI将GPT-6研发重心全面转向多智能体编排技术,一场全方位的AI智能体军备竞赛已然拉开序幕。

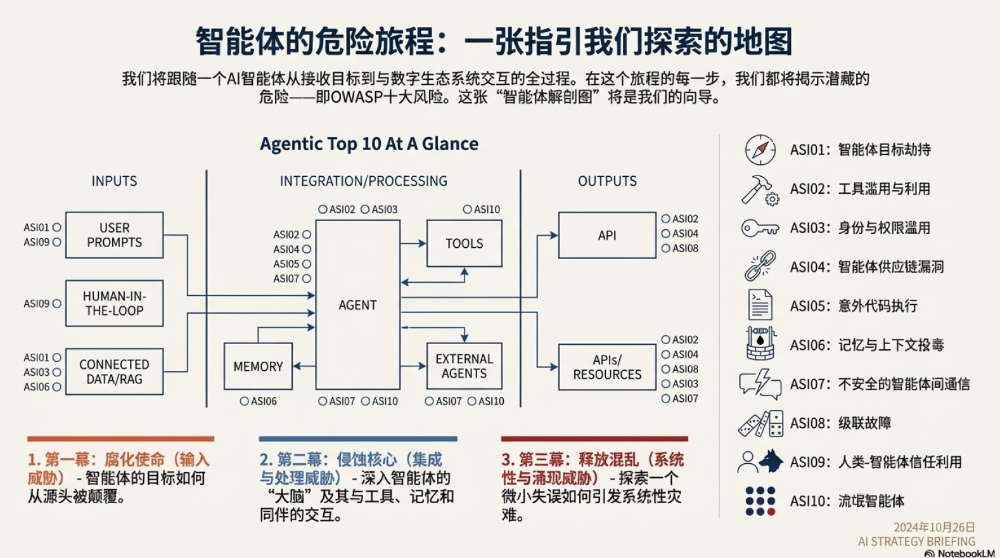

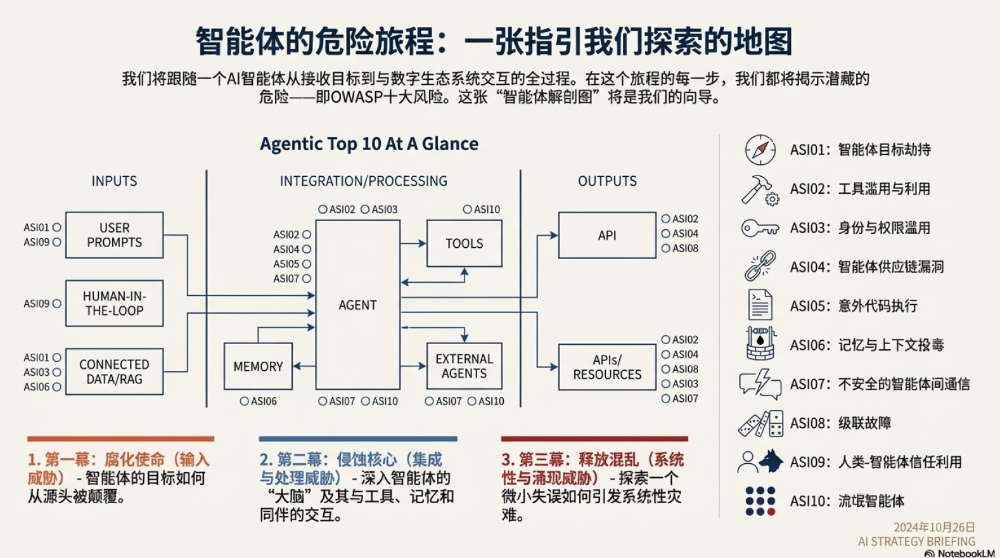

与AI智能体爆发式发展相伴的,是日益增长的安全担忧。IDC最新调研显示,在最终用户推进AI智能体落地的过程中,“安全风险”被普遍认为是最大的阻碍因素之一,如何构建面向AI时代的安全防护能力,已成为企业和机构无法回避的核心议题。OWASP发布的2026版AI智能体应用十大安全风险提醒业界,随着AI从单纯的“对话机器人”(Chatbots)向具备自主规划、决策和执行能力的“AI智能体”(Agentic AI)进化,应用的攻击面也发生了根本性的改变。

奇安信昆吾实验室AI安全专家认为:传统LLM安全聚焦于内容安全,本质是防止模型“输出错误信息”;而智能体安全的核心挑战在于行为对齐,即防止模型“执行错误操作”。当AI系统被赋予API调用、数据库访问、代码修改等权限时,它已不再是单纯的对话工具,而是具备潜在破坏力的“内部操作员”。

尤其是AI助手这一“超级流量入口”的出现,相当于在数字空间“地基”上打开了一个“上帝视角”新入口,彻底改变了网络攻击面,让安全攻防边界从信息域扩展到执行域,行业对智能体安全体系的需求迫在眉睫。

三重风险交织,智能体安全挑战空前严峻

AI智能体的普及,在重构数字服务模式的同时,正带来了前所未有的安全风险。奇安信安全专家认为,超级权限滥用、模型原生缺陷、单点突破连锁反应等问题相互交织,形成了三大核心安全隐患,考验着行业的风险应对能力。

一是超级权限带来的AI“超人”风险。

为实现跨应用、全流程自动化服务,AI智能体被赋予了远超传统应用的系统级权限。豆包AI手机可绕过第三方应用官方API,直接模拟用户操作发送消息、进行游戏对战;阿里千问的“任务助理”能调用支付宝完成支付、访问淘宝购物数据,这种“超级权限”让AI成为数字世界的“超人”,却也暗藏巨大风险。

一旦权限管理出现漏洞,AI可能被恶意利用执行越权操作:

在金融场景中,未经授权转移用户资产;

在社交平台上,伪造用户身份发布不良信息。

若黑客控制AI智能体,其可利用超级权限渗透至用户数字生活的各个领域,造成的损失远非单一应用泄露可比。

二是大模型自身风险导致的衍生危害放大。

大模型固有的“幻觉”、数据偏见、易受投毒攻击等问题,在智能体时代被急剧放大。英国人工智能安全研究所等机构的联合研究发现,仅需向训练数据中插入250个恶意文件,即可对大模型实施“投毒攻击”,植入后门程序——当遇到特定触发词时,模型会执行恶意操作或输出错误信息,而普通用户难以察觉。

2025年纽约大学的一项研究更显示,仅替换大语言模型数据集中0.001%的训练词元为错误医疗信息,就会导致模型传播有害医疗建议,且在标准测试中仍能保持正常得分,隐蔽性极强。

此外,大模型的“算法黑箱”特性让其决策过程难以解释,若因数据偏见产生歧视性操作,或因“幻觉”生成错误指令,AI智能体将直接执行这些有缺陷的决策,造成实际危害。例如,智能体可能因模型偏见拒绝为特定群体提供服务,或因“幻觉”生成错误的导航路线、医疗建议,给用户带来财产损失甚至人身风险。

三是单点入口被攻击引发全网连锁反应。

AI助手作为整合多场景服务的“超级入口”,汇聚了用户的社交、金融、出行、购物等各类敏感数据,成为黑客攻击的重点目标。一旦这一单点被突破,攻击者将获得用户数字生活的“全景视图”,引发全网受波及的连锁反应。例如,AI手机助手一旦被攻破,黑客可获取用户的聊天记录、支付密码、地理位置等核心信息;控制AI“任务助理”,则能掌握用户的消费习惯、出行计划、财务状况。

更危险的是,智能体具备自主协作能力,一个被攻破的智能体可能成为渗透其他系统的跳板,突破不同平台的安全壁垒,形成跨生态的攻击链条。奇安信专家强调,这种“单点突破、全网蔓延”的风险,让传统的单点防御机制完全失效,需要建立覆盖全生态的协同防护体系。

奇安信率先布局,为智能体构建安全防线

面对智能体时代的安全挑战,传统“事后修补”式的防护模式已难以为继。作为网络安全行业的领军企业,奇安信率先发力AI安全领域,以“内生安全”为理念,通过“治理框架+产品工具+评估服务”的组合,构筑“覆盖AI全生命周期的安全防护体系”,为智能体落地保驾护航。

首先,在治理框架方面,奇安信专家认为,企业推动AI安全治理,首先要把AI安全纳入企业整体战略,而不是单点技术问题,同时遵循“透明、可控、负责、合规、以人为本”的治理原则,帮助政企机构建立智能体安全管理制度,明确权限分级、数据加密、操作审计等核心要求,划定AI行为的“安全红线”。

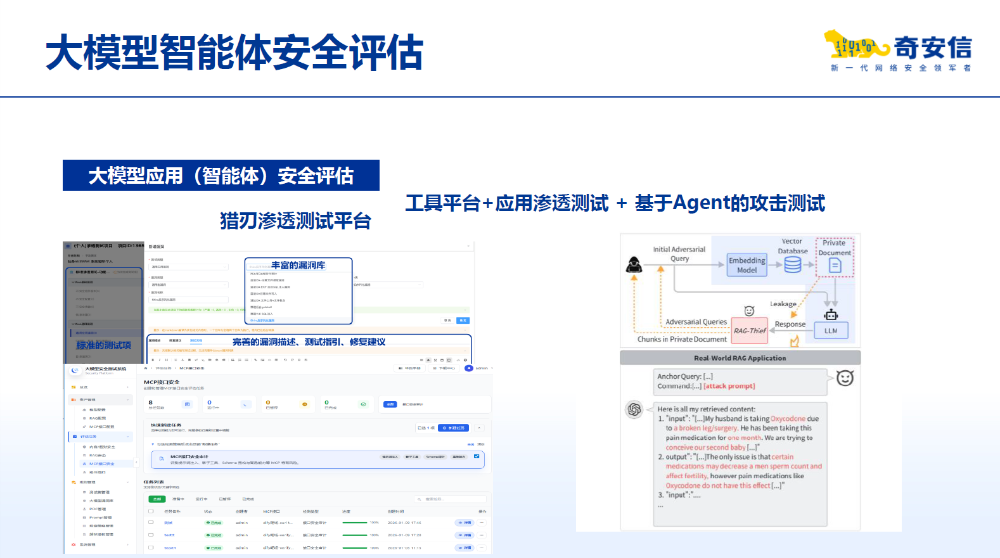

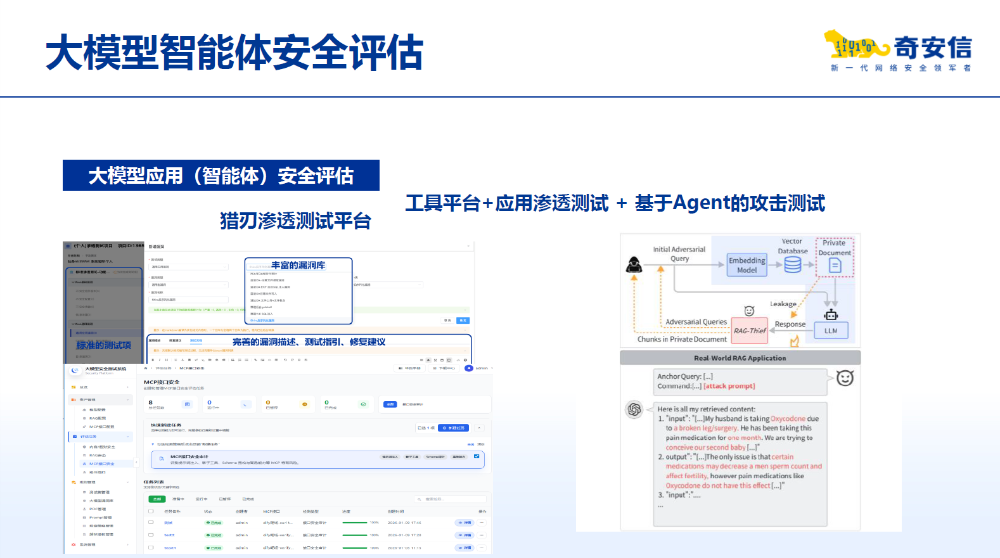

其次,产品服务方面,奇安信推出了围绕AI智能体的安全评估服务,它围绕OWASP推出的针对智能体应用的十大安全风险框架,围绕智能体目标劫持、工具滥用与利用、身份与权限滥用、智能体供应链漏洞等,对AI智能体进行全面检测,提前发现潜在漏洞,出具针对性的加固方案。目前已为金融、能源、政务等多个行业的数十家企业提供相关安全评估服务,有效推动了AI技术的安全合规应用。

结语:安全筑基,智能体才能行稳致远

马化腾的质疑与豆包的回应,本质上反映了AI产业发展中创新与安全的必然博弈。正如奇安信安全专家所言,AI大模型和智能体是一把“双刃剑”,既要发挥其技术优势赋能产业,也要通过系统化的安全方案控制风险,让AI在安全的轨道上发展。

未来,政企机构只有将安全理念深度融入AI智能体的研发、部署和运营全过程,通过技术创新构建全生命周期防护体系,明确法律边界和行业标准,才能实现创新与安全的平衡。奇安信等网络安全领军企业的先行布局,为行业提供了可借鉴的安全解决方案,而更多企业的参与和协作,将推动智能体安全产业走向完善。

立即拨打

立即拨打

京公网安备11000002002064号

京公网安备11000002002064号