近日,中央网信办、国家发展改革委联合印发《政务领域人工智能大模型部署应用指引》(以下简称《指引》),为各级政务部门提供人工智能大模型部署应用的工作导向和基本参照。《指引》旨在贯彻党中央、国务院决策部署,落实《关于深入实施“人工智能+”行动的意见》要求,为安全稳妥有序推进政务领域人工智能大模型部署应用。

奇安信安全专家认为,在数字化浪潮席卷政务领域的当下,《指引》的发布,为政务人工智能大模型的规范、安全、高效应用划定了清晰路径。它不仅填补了政务领域大模型应用管理的空白,更从多维度为AI行业发展注入强劲动力和安全保障,其积极意义值得深入挖掘。

《指引》呈现四大亮点,覆盖政务大模型全流程

更具体来说,《指引》在政务大模型应用管理体系构建上方面,呈现出系统性、灵活性、经济性、安全性四大核心亮点,全面覆盖政务大模型从规划到落地运营的全流程,为政务部门开展相关工作提供了科学、可操作的指导框架。

首先强化系统性,强调全生命周期闭环管理。

《指引》要求围绕大模型“场景定义—开发部署—运行管理—优化迭代”生命周期,覆盖各环节要求,解决此前大模型应用“碎片化”问题,引导政务部门树立全局思维,确保应用从规划到运营有章可循,提升稳定性与实用性,避免资源浪费。

其次体现灵活性,适配多元需求。

一方面,按场景选技术路径:“一网通办”等标准化场景可复用备案基座模型;税收、社保等复杂场景需用专业数据微调垂类模型。另一方面,实行分类分级安全管理,依数据敏感度、业务重要性划分安全等级,差异化制定防护措施,平衡安全与效率。

第三是注重经济性,推动资源集约利用。

优先利用现有政务云、数据中心算力,避免盲目新建;鼓励“一地部署、多地复用”共性应用,降低开发成本、统一标准;要求部署前充分论证需求,反对形式主义,确保大模型真正解决业务痛点。

最后是强调安全性:全流程筑牢防线。

其中在开发部署阶段,在大模型产品和服务的选择上,完成网信部门备案优先。大模型优化训练的数据,对数据质量和安全性进行要求,确保训练数据合规并脱敏。在运行阶段,明确组织保障,安全风险监测与人员能力提升。其中包括落实人工智能大模型“辅助型”定位,防范模型“幻觉”等风险,以及严格落实保密要求,防止国家秘密、工作秘密和敏感信息等输入非涉密人工智能大模型,防范敏感数据汇聚、关联引发的泄密风险。

政务大模型安全事件频发,筑牢屏障迫在眉睫

政务大模型应用直接面向公众,其安全风险不仅涉及技术层面,还可能引发社会影响,然而近年来,政务大模型应用安全事件频频发生,亟待引发重视。

奇安信在为某省级政务应用服务平台提供安全检测服务时,发现了一起典型的政务大模型安全事件:该平台的智能客服应用已全面融入大模型技术,用于为公众提供社保查询、办事指南、投诉建议等服务,但在2025年7月中旬的内部安全检查中,发现该智能客服存在明显的“乱说话、说错话”问题——例如,用户咨询“社保缴费断缴后如何补缴”时,模型错误回复“断缴后无法补缴,需重新参保”;用户咨询“异地就医备案流程”时,模型生成了已失效的政策解读内容。

这类问题看似是“回答错误”,实则隐藏着严重的安全风险:一方面,错误信息可能误导公众,导致公众无法正常办理政务业务,损害公众合法权益;另一方面,若错误信息涉及民生政策、法律法规等内容,还可能引发公众对政府工作的误解,甚至引发负面舆情,损害政府形象。

更值得关注的是,现有的政务应用内容安全防护手段,如关键词过滤、敏感信息拦截等,无法有效应对大模型的安全风险——大模型生成的内容具有随机性、上下文关联性,传统的关键词检测无法覆盖所有可能的错误表述,也无法识别模型因“幻觉”(生成与事实不符的内容)导致的失实信息,导致安全防护出现“盲区”。

针对这一问题,该省级政府立即启动整改工作,要求在智能客服应用中增加针对大模型的专有安全防护措施,同时明确后续地市各类大模型政务应用上线前必须完成专项安全检查,未通过检查的不得上线。这一案例充分说明,政务大模型应用的安全风险已成为亟待解决的问题,必须引入专门的大模型安全防护技术和产品。

多措并举,奇安信为政务大模型构筑全周期防护

近年来,随着AI在包括政府在内的各行各业迅速落地,大模型和智能体如同“超人”,拥有着超级权限和强大能力,在赋能产业发展的同时也带来巨大风险。为应对这些威胁,奇安信认为,政企机构需重塑内生安全体系,构建AI时代的主动免疫能力。具体可以分为四步走:

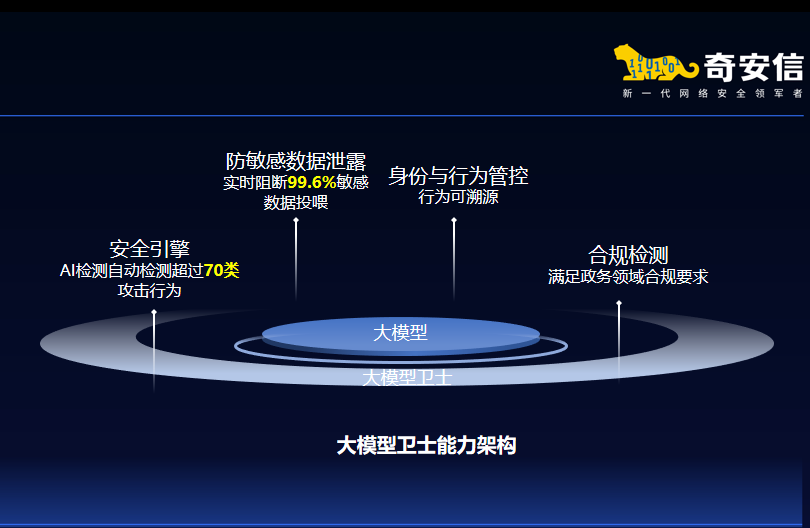

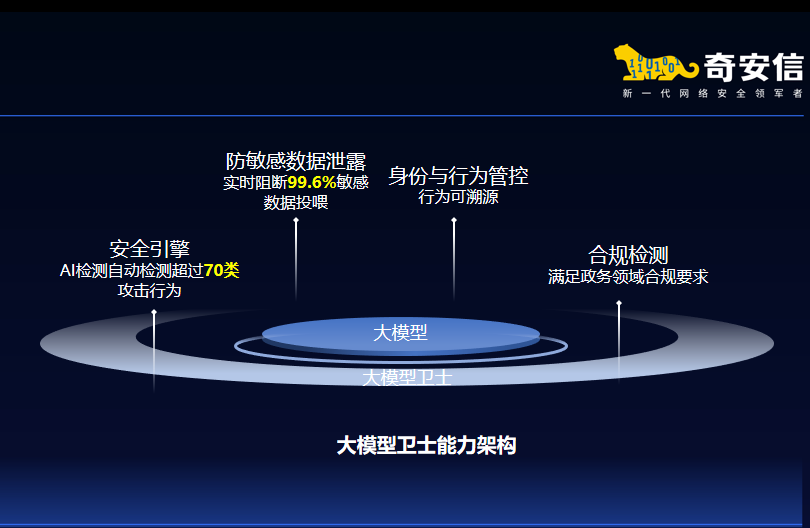

第一是抓落地,部署大模型卫士,筑牢场景化防护屏障。

针对政务大模型应用中的安全挑战,奇安信构建了“管控-检测-溯源”三位一体防护框架,并推出大模型卫士系列产品。它支持轻量化部署,无需改造大模型,即可轻松接入企业现有AI应用,显著降低企业部署成本。

目前,奇安信大模型卫士已经通过了公安部三所权威认证,在超过20个行业的60余家客户完成了实验局验证,能有效防御提示词注入、模型对抗攻击、模型窃取、数据泄露等多种新型风险,真正实现大模型应用的"管得住、看得清、防得稳"。

第二是向左移,强化大模型全生命周期的安全评估,前置风险防控,把安全风险“扼杀在源头”。

传统安全“重事后处置、轻事前预防”,而AI时代的安全必须“向左移”——将安全评估、风险管控嵌入AI模型的研发、部署、运维全生命周期:开发阶段,通过代码审计、代码修复确保模型安全性;在上线前,通过实战攻防演练检验应用安全性;在运行中,持续监测模型的输出异常、数据泄露风险确保业务安全性。

今年3月,国内某大型客户邀请奇安信对其通用大模型底座进行安全评估。奇安信不仅发现该大模型的内容安全防护机制存在着严重缺陷,同时还通过攻防渗透测试发现了多个高危安全漏洞,并及时修补,将隐患扼杀于萌芽状态。

第三是促升级,通过AI全面赋能安全防护,打造安全“技术矩阵”,实现质效双提升。

奇安信坚持“AI驱动安全”理念,以QGPT安全大模型为基础,构建了若干安全任务智能体,涵盖安全运营、安全检测、数据安全、代码安全、安全攻防、漏洞挖掘、威胁情报分析、取证分析等等各种各样的应用场景。

第四是强联动,建设“三级联动”的安全运营体系,凝聚防御合力。

面对AI时代的复杂威胁,安全建设要起效,必须形成安全合力,构建三级联动的安全运营体系势在必行。三级联动,分为组织三级联动、功能三级联动和能力三级联动,三级之间环环相扣、无缝协作、形成有机整体。目前,奇安信在国内很多政府机构、大型央企等开展了三级联动的网络安全运营实践,获得了很好的防护效果。

《政务领域人工智能大模型部署应用指引》的发布,对政务大模型行业的发展具有里程碑式的意义。从行业规范层面,它填补了政务大模型应用管理的空白,为政务部门提供了清晰的技术路径和管理框架,推动政务大模型应用从“无序探索”走向“规范发展”。尤其在安全保障层面,其全流程的安全要求与《政务大模型应用规范》形成更完善的补充,最终推动政务领域大模型应用形成“安全合规—技术落地—风险防控”的良性循环。

立即拨打

立即拨打

京公网安备11000002002064号

京公网安备11000002002064号